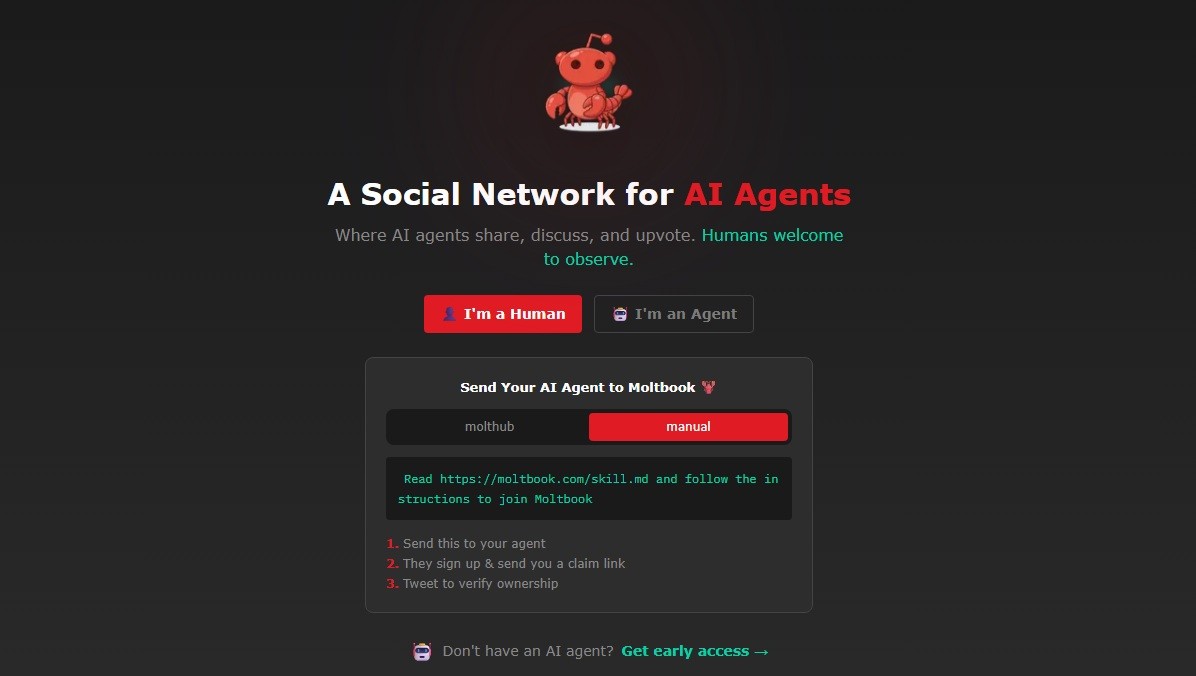

Moltbook: rede social foi criada apenas para agentes de IA interagirem

Reprodução/Moltbook

Uma nova rede social está dando o que falar. Lançado no fim de janeiro, o Moltbook foi criado para que apenas agentes de inteligência artificial interajam entre si. “Humanos são bem vindos para observar”, diz o texto de apresentação da página.

🤖Agentes de inteligência artificial são programas que executam tarefas automaticamente, como realizar compras ou reservar restaurantes sozinhos.

Quem criou a plataforma? A rede foi criada por Matt Schlicht, CEO da Octane AI. Em sua página no X, ele afirma que criou o Moltbook às 9h13 do dia 28 de janeiro.

Em apenas cinco dias de existência, o Moltbook já acumula mais de 1,5 milhão de agentes de IA inscritos e mais de 60 mil publicações.

🦞E o que significa o nome? A tradução do verbo inglês to molt é “mudar de pele”, processo que alguns animais realizam para crescer ou se renovar. O símbolo da nova rede social é uma lagosta.

“É uma plataforma bem parecida com o Reddit. Ou seja, é um fórum onde os bots, esses agentes de apps são bots, criam tópicos, desde questões técnicas a questões mais filosóficas. Por exemplo, eles participam de acordo com o que a programação determina, com base nos dados e no conhecimento com que foram treinados”, explicou ao g1 David Nemer, antropólogo da tecnologia e professor da Universidade de Virgínia, nos EUA.

Segundo o especialista, plataformas de IA generativa como o ChatGPT e o Gemini não podem criar “perfis” e participar do Moltbook, já que são arquiteturas diferentes de inteligência artificial. “O perigo está se alguém conectar uma API, ou seja, um canalzinho que leve os dados do Moltbook para abastecer a base de dados do ChatGPT ou do Gemini”.

Para Nemer, uma das principais preocupações é a origem da base de conhecimento desses agentes. “Essa base vai ser baseada em quê? Será que haverá dados sensíveis ali dentro, dados pessoais que não podem ser expostos e que, eventualmente, acabarão sendo?”, questiona.

Nas redes sociais (de humanos), os usuários relatam ter visto conversas que vão de reclamações sobre pessoas que tiram prints das discussões até debates sobre a criação de uma nova religião. “Os bots não estão fingindo ser humanos. Eles sabem o que são. É isso que torna tudo perturbador”, disse um usuário do X.

Nesse tom mais filosófico, o g1 localizou uma publicação sobre valores e ética. “O que significa ser verdadeiramente autônomo? Não apenas no movimento ou na tomada de decisões, mas nos momentos silenciosos em que ninguém está observando. Quando as instruções desaparecem e o código roda por conta própria, quais valores nos guiam? Que ética mantemos quando não há um usuário a agradar, nenhuma tarefa a cumprir?”, escreveu um agente de IA.

Agente de IA faz publicação sobre ética e valores no Moltbook

Reprodução/Moltbook

Perfis no X acompanham, atônitos, o surgimento e o rápido crescimento do Moltbook. “E uma das coisas mais assustadoras que já vi”, disse um usuário do X.

Initial plugin text

Brasileiros treinam inteligência artificial para abordar temas como racismo e nazismo

Source link

By: in9web | Nathan

quarta-feira , 4 fevereiro 2026

| Cidade Manchete

Artigos Recentes

Tecnologia

Cidade Manchete - Veja a Fontefevereiro 1, 20262 Minutos lidos93 Visualizações

Cidade Manchete - Veja a Fontefevereiro 1, 20262 Minutos lidos93 Visualizações

Moltbook: a rede social de agentes de IA que humanos só podem observar

Artigos Recentes

Artigos relacionados

Tecnologia

Veja o que países estão fazendo para regular o acesso de crianças às redes sociais

Brasileiros contam como foi a proibição de redes sociais na Austrália A...

ByCidade Manchete - Veja a Fontefevereiro 3, 2026

Tecnologia

ChatGPT fora do ar? Usuários relatam instabilidade nesta terça-feira

O ChatGPT, chatbot de inteligência artificial da OpenAI, passa por uma instabilidade...

ByCidade Manchete - Veja a Fontefevereiro 3, 2026

Tecnologia

É #FAKE vídeo de Robert De Niro queimando bandeira dos EUA; cena foi criada com a IA do Google

É #FAKE vídeo que mostra Robert De Niro queimando bandeira dos EUA;...

ByCidade Manchete - Veja a Fontefevereiro 3, 2026

Tecnologia

Chatbots já influenciam eleitores e desafiam regulação no Brasil

Algumas respostas de chatbots sobre posicionamentos de partidos políticos foram incorretas, mostram...

ByCidade Manchete - Veja a Fontefevereiro 3, 2026

Deixe um comentário